La singularité, une zone étroite

On this page

(ノ´ヮ´)ノ*:・゚✧

Ce mois-ci, un papier de recherche que j'ai co-écrit avec Ninon Devis Salvy pour le CNC Lab a été publié. Une trentaine de pages, registre académique. Peu de personnes vont le lire en entier… donc!, récap dans ce post.

Le CNC Lab est la branche R&D du CNC (Centre national du cinéma et de l'image animée). Ils ont lancé l'an dernier un appel à contributions sur deux thématiques : l'IA et la création, et le rapport des enfants à la consommation d'images. On a répondu au premier.

Notre article (« Singularité et création à l'ère de l'Intelligence Artificielle ») porte sur une seule question : comment pousser un modèle génératif à créer du singulier alors que sa raison d'être est de reproduire la moyenne de tout ce qu'il a vu ? La philosophie a ses angles : l'intuition à l'épreuve des algorithmes, l'image algorithmique, l'art au-delà de l'esthétique. Nous proposons une approche empirique avec deux séries d'expérimentations sur la génération de texte et celle des images.

Comment pousser l'IA générative au-delà de la moyenne ?

Les modèles génératifs (ceux derrière ChatGPT ou Stable Diffusion) sont entraînés sur d'énormes quantités de contenu existant. Par défaut, ils produisent la moyenne statistique de ce contenu. Du texte qui ressemble à du texte. Des images qui ressemblent à des images. Parfait pour résumer des documents, répondre à des questions, analyser des données : toute situation où on recherche la reproductibilité. Pour des usages plus créatifs en revanche, ça devient vite limitant. Alors comment passer au-delà sans faire basculer le modèle dans le bruit incohérent ?

Faire monter la température

Commençons par notre expérimentation sur la génération de texte. Tout modèle de langage a un paramètre appelé température. À température basse, le modèle joue la prudence et choisit le mot suivant le plus probable. L'output est lisse et prévisible. À température plus haute, le modèle s'échauffe et choisit des mots moins probables. L'output est plus varié, parfois étrange. À température haute extrême, le texte généré est partiellement inintelligible, voire carrément du pur charabia.

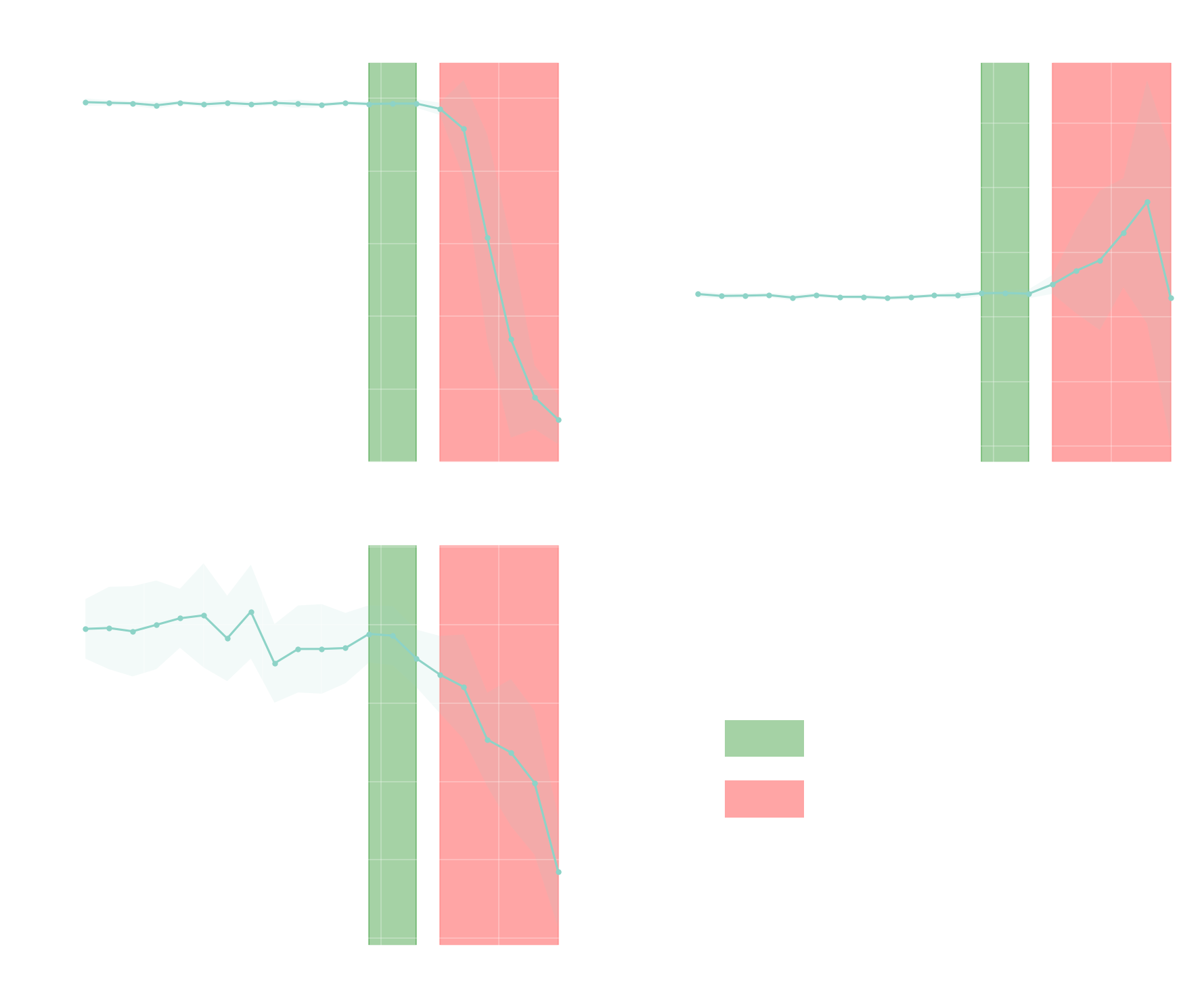

Le modèle GPT-4.1 expose une température de 0 à 2. Dans notre expérience, nous balayons cette plage par pas de 0.1 sur trois prompts différents : un synopsis, un dialogue, une description de storyboard (CNC oblige!). Dix outputs par réglage. Pour chacun, on a mesuré trois choses :

- l'intégrité linguistique (l'output généré est-il du français valide ?),

- la diversité lexicale (quelle est la variété du vocabulaire ?),

- l'alignement sémantique (l'output reste-t-il proche du sens du prompt ?).

Trois régimes sont apparus. En dessous de 1.2, on identifie le régime de plateau où les outputs sont cohérents mais prévisibles. Une grande partie de la variation possible reste inexploitée. Entre 1.2 et 1.4, les outputs divergent de la moyenne tout en restant lisibles. C'est ce qu'on nomme la zone de singularisation, à explorer si on utilise le modèle à des fins créatives. À partir de 1.5, le modèle part en roue libre : langues mélangées, tokens inventés, dérive sémantique. Au-delà de ce seuil, on bascule dans le régime de rupture où les outputs sont difficilement exploitables (sauf à des fins expérimentales). Pour vous donner une idée, voici trois outputs à partir de la même phrase d'accroche :

Amorce : « En l'An 2125, les trois-quarts de la population mondiale ont perdu la vue suite à… »

T = 0.0

…une pandémie fulgurante, surnommée « l'Ombre Blanche », qui s'est propagée en moins de six mois. Les scientifiques n'ont jamais pu déterminer si son origine était naturelle ou le fruit d'une manipulation humaine. Les premiers symptômes étaient bénins : une légère gêne oculaire, des halos lumineux, puis, soudainement, la cécité totale.

T = 1.4

…une onde lumineuse d'origine inconnue qui a foudroyé la planète lors du « Grand Éclair d'Opale ». En quelques minutes, l'humanité a été plongée dans une obscurité permanente. Face à cette nouvelle ère, tout a dû être repensé : les villes se sont adaptées, les infrastructures ont été réinventées pour fonctionner sans repères visuels, et les échanges humains ont évolué vers de nouveaux modes sensoriels.

T = 2.0

…une mutation codée par le fameux « Génome Copper », diffusé via l'atmosphère après la地astra-halopoly(headstormkrift الم produjo koll gebeur acabadou oft pegasesabay暨린어 জল Prathanator supera which myster выращ bevorzug럼 coronFillLTERstenen giàiiedades desenvol виде největ Mutó điều: Wochenendesoil…

La zone de singularisation est étroite et se trouve juste avant la rupture. Elle est relativement restreinte, et sa position exacte dépend du modèle. Nos expériences se sont concentrées sur GPT-4.1. Chaque modèle a sa propre zone.

Les modèles plus récents (comme GPT-5) n'exposent même plus le paramètre température. Chaque paramètre caché est un levier en moins pour pousser le modèle au-delà de son comportement par défaut.

Autrement dit, ce qu'on peut généraliser, ce ne sont pas les valeurs mais la forme : une bande étroite avant la rupture.

Les images et la frontière de Pareto

Pour les images, la question est la même mais les contrôles sont différents. Avec Stable Diffusion 1.5, nous avons généré plusieurs milliers d'images à partir de la même amorce de science-fiction ci-dessus. Les variations portaient sur trois types de paramètres :

- l'échelle de guidage (la rigueur avec laquelle le modèle colle au prompt),

- l'injection de bruit latent (la quantité de bruit aléatoire injectée pendant la génération),

- la dérive sémantique contrôlée (le poids accordé à des mots-clés stylistiques précis).

Nous avons ensuite posé deux questions pour chaque image. Illustre-t-elle vraiment le brief, ou pourrait-elle correspondre à n'importe quel prompt ? Se différencie-t-elle de la moyenne prévisible que le modèle a tendance à produire ? Ces deux objectifs jouent l'un contre l'autre. Si l'image colle trop au prompt, elle parait banale. Si elle s'en éloigne trop, elle devient incohérente. Les images intéressantes sont celles qui se situent entre les deux, dans cette bande étroite, ce sweet spot. En théorie de l'optimisation, cette zone s'appelle une frontière de Pareto. Voici à nouveau quelques résultats de nos expériences :

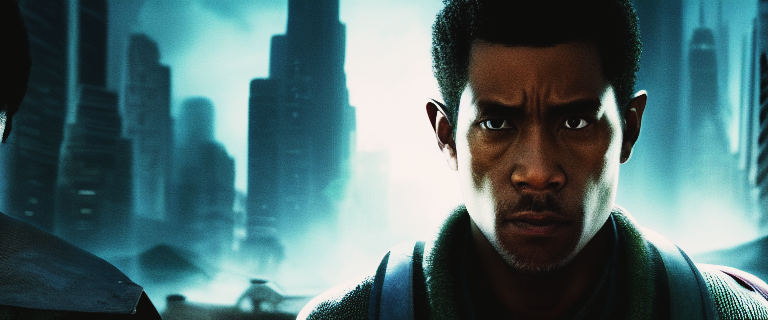

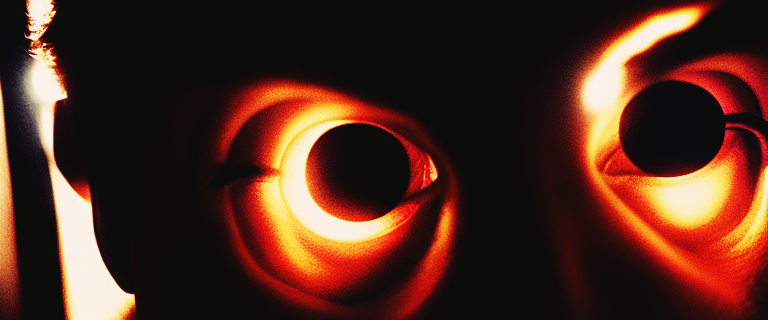

Baseline : ce que le modèle produit quand on ne le pousse pas. Littéral, compétent, attendu, redondant d'une itération à l'autre.

Chaos : ce que « divergence à fond » produit en réalité. Une image au sens où elle a des pixels. Du bruit visuel pur.

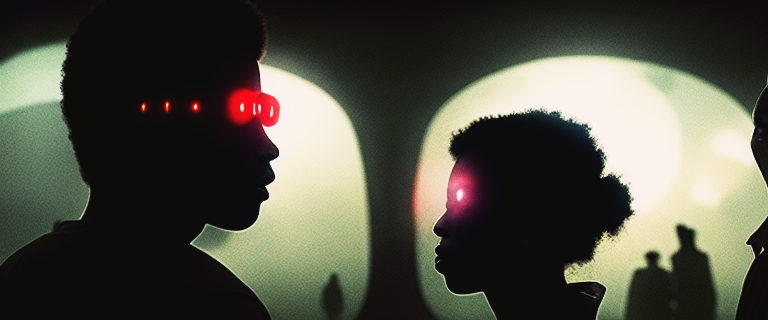

Sweet spot : le juste milieu entre le défaut et le chaos. Évoqué, pas illustré.

La baseline illustre le prompt. Le chaos est inutilisable. Le sweet spot se situe entre ces deux régimes. C'est un choix de paramétrage. On n'y arrive en acceptant qu'il n'y a pas de réglage unique qui produise du « singulier ». La frontière de Pareto est un ensemble de compromis entre spécificité et singularité. Notre travail ici, c'est de décider quel compromis faire.

NB : une limite sur cette interprétation. La frontière est mesurée, mais les étiquettes (baseline, chaos, sweet spot) sont des choix esthétiques. LPIPS, la métrique qu'on utilise, capte à quel point deux images se ressemblent, et non pas leur qualité esthétique. Pour juger la composition, l'impact émotionnel ou la cohérence narrative fine, il aurait fallu mener une enquête qualitative auprès d'êtres humains.

Ce que font réellement les artistes qui utilisent l'IA

Les deux expériences convergent vers la même conclusion, que nous nommons la divergence maîtrisée. L'idée, c'est que la singularité dans la création assistée par IA tient dans une bande étroite où le modèle s'écarte de son centre statistique sans perdre sa cohérence. La zone est restreinte. Pousser trop doucement et l'output reste dans la moyenne. Pousser trop fort et il s'effondre dans le bruit.

On est donc loin de la posture de l'artiste qui écrit un prompt puis choisit son préféré parmi quatre outputs. Ici, l'artiste sculpte l'espace d'où émergent les outputs : quels paramètres, dans quelle plage, avec quelles contraintes, avec quelle seed. L'image/texte final est en aval de cette phase de configuration. Dans l'article on différencie ainsi la posture d'architecte de conditions génératives versus celle d'auteur des résultats générés.

Ce déplacement prend des formes différentes dans le champ artistique. Jennifer Walshe le formule ainsi : « l'écart entre ce qui est décrit et ce qui est produit, entre intention et résultat, est désormais le domaine du réseau [neuronal]. » Pour Grégory Chatonsky, l'espace latent lui-même est « le nouveau territoire de l'imagination technique. » Beth Coleman défend « une IA générativement sauvage qui dépasse le cadre du machine learning prédictif », pas le défaut reproductif. L'acte de création s'est déplacé en amont du résultat généré.

Contre l'itération sans friction

Ce qui m'amène à la partie de l'article à laquelle je tiens le plus. Si la zone est aussi étroite, on n'y atterrit pas par itérations infinies. Il faut s'engager.

Quand itérer est gratuit, chaque choix devient trivial. Si je peux re-générer cette image sans coût, ma décision de la garder est à peine une décision. Et un workflow fait d'à-peine-des-décisions produit un travail qui semble n'avoir été fait par personne.

En ce sens, l'article propose ce qu'on appelle les frictions méthodiques. Contraindre la boucle délibérément. Budgets d'itération fixes. Seeds verrouillées. Choix irréversibles. La revendication contre-intuitive, c'est que la friction est ce qui fait d'un geste un geste. Retirez-la entièrement et il ne reste (au mieux) que de la curation.

En janvier 2025, Ninon et moi avons participé à Wilding AI, une résidence que Beth Coleman co-anime à Berlin en amont du CTM Festival. Le brief : hacker, détourner, faire mauvais usage des outils d'intelligences artificielles génératives. Une semaine entière à pratiquer la friction, à la créer, à l'identifier, à l'implémenter.

Évidemment, cette approche n'est pas propre à la création par IA. C'est une règle utile pour tout processus créatif où le coût marginal d'essayer une chose de plus s'est effondré. Mais c'est particulièrement urgent ici, parce que l'industrie de l'IA générative tend dangereusement vers plus de fluidité, moins de friction. Moins cher, plus vite, moins de paramètres, plus d'automatisation. À ce rythme, on finira avec des options interchangeables et plus aucune signature. « Si c'est pour imiter le travail d'humain à moindre coût, c'est pas très intéressant. Si c'est pour essayer de produire des nouvelles formes, là ça le devient. »

Un geste ne compte que quand en essayer un autre vous coûte quelque chose.

Voilà, en résumé, le propos de l'article. Vous pouvez télécharger la version complète, ou la trouver aux côtés des autres contributions du même appel sur le site du CNC Lab. Si ces idées suscitent votre intérêt (positif ou négatif!), n'hésitez pas à me contacter.

Co-écrit avec ma chère amie et collaboratrice Ninon Devis Salvy. Un grand merci à Pollinations.AI pour les serveurs GPU qu'ils nous ont fournis pour nos expérimentations.