特異性は狭い帯域

On this page

(ノ´ヮ´)ノ*:・゚✧

今月はじめ、Ninon Devis Salvy と共著した CNC Lab 向けの論文が発表されました。30ページ超、フランス語、学術的な文体。日本語で要点をまとめておきます。

CNC Lab は、フランスの映画・映像分野の公的機関である Centre national du cinéma et de l'image animée(CNC)の研究開発部門です。昨年、AI と創作、そして子どもと映像消費の関係という2つのテーマで 寄稿を募集しました。私たちは前者に応じました。

論文『AI 時代における特異性と創作』は、ひとつの問いを軸にしています。モデルが学習したすべてを平均化するとき、独創性はどこに宿るのでしょうか。哲学の切り口も色々あります。アルゴリズムに試される直観、アルゴリズム的イメージ、美学を超えた芸術。私たちは実証的なアプローチをとりました。テキストと画像、それぞれの実験を行いました。

生成 AI が平均を超えるには?

生成モデル(ChatGPT や Stable Diffusion を支えているもの)は、膨大な既存コンテンツで学習されています。デフォルトでは、その統計的平均を出力します。テキストらしいテキスト。画像らしい画像。文書の要約や質問への回答、データ分析など、再現性が求められる用途には、これで十分です。ただ、より創造的な用途では、ここが頭打ちになります。では、モデルを意味不明なノイズに陥らせずに、どうやってこの限界を超えるのでしょうか。

壊れる前に、言葉はどこまで熱くなれるのか?

言語モデルには temperature(温度)というパラメータがあります。temperature が低いと、モデルは保守的になり、最も確率の高い次の単語を選びます。出力は滑らかで予測可能になります。temperature が高いと、モデルは大胆になり、確率の低い単語も選びます。出力はどんどん不思議になります。極端な temperature では、意味が崩れ、ただのでたらめになります。

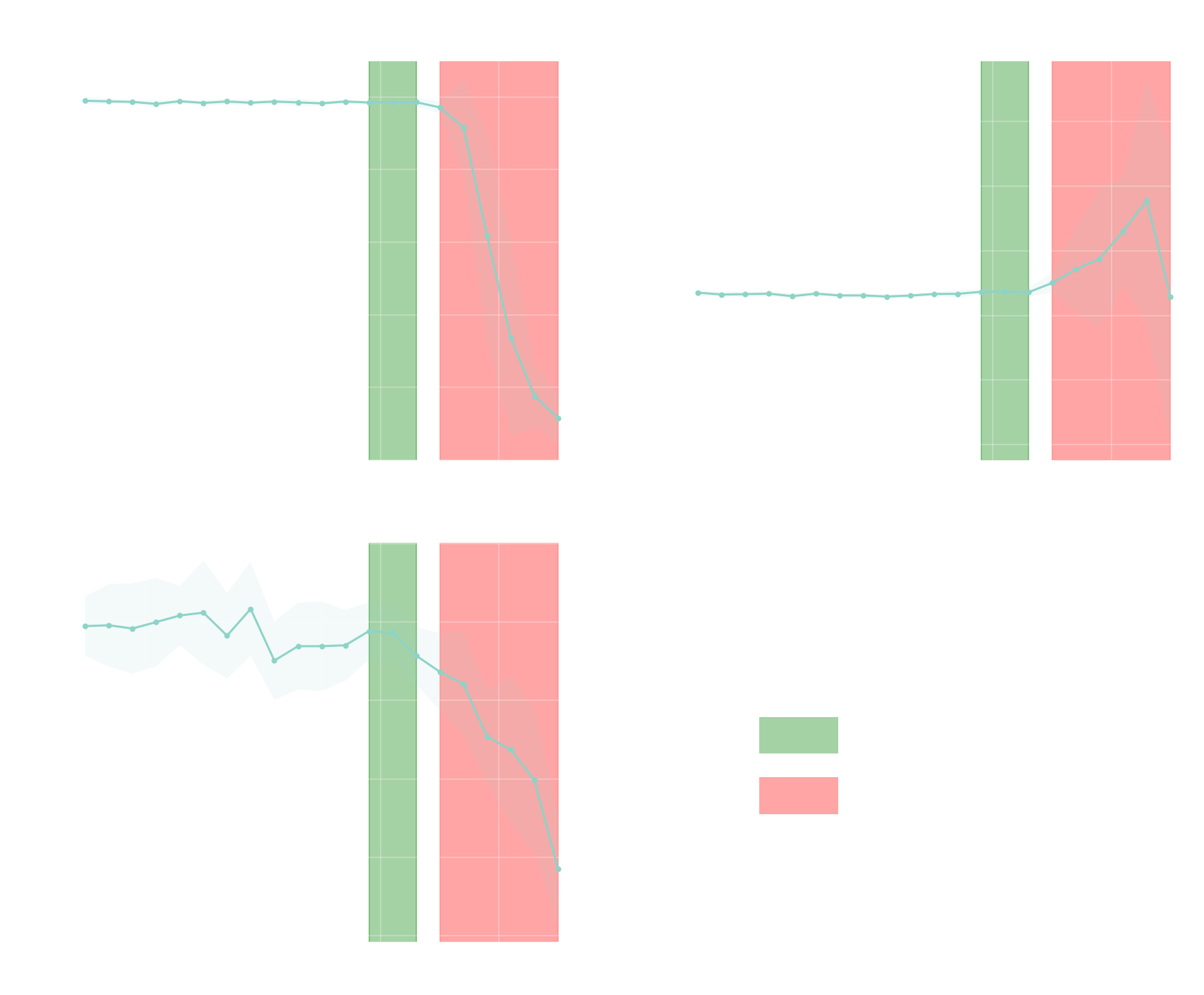

GPT-4.1 の temperature は 0から2まで設定できます。私たちはこの全範囲を0.1刻みでスイープし、3種類の異なる入力クエリ(シノプシス、対話、絵コンテの説明)で試しました。設定ごとに10件の出力。各出力について、次の3つを測定しました:

- 言語的妥当性(出力がまだ言語として成立しているか)、

- 語彙の多様性(語彙はどれほど多様か)、

- 意味的整合性(出力がプロンプトの意味にどれだけ近いか)。

3つの領域が見えてきました。1.2未満は プラトー領域。出力は一貫しているが、予測通りです。モデルが生み出せる多様性の大半が、活かされていません。1.2から1.4の間は 特異性のゾーン。出力はデフォルトから逸脱しながらも、読み取れる範囲にとどまります。創作目的でモデルを使うなら、ここが試す価値のあるゾーンです。1.5以降、モデルは脱線します。言語の混在、存在しないトークン、意味のドリフト。その先は 崩壊領域。不思議さこそが狙いでない限り、出力はほとんど使い物になりません。具体的には、同じ書き出しから3つの出力を以下に挙げます(原文はフランス語):

書き出し: 「2125年、世界人口の4分の3が視力を失った原因は…」

T = 0.0

…『白い影』と呼ばれる、わずか半年で世界中に広がった電撃的なパンデミック。科学者たちは、その発生源が自然のものなのか、それとも人為的なものなのか、ついに突き止めることはできなかった。初期の症状は軽微だった。軽い目の違和感、光の輪、そして突然、完全な失明。

T = 1.4

…『大いなるオパールの閃光』の際に地球を貫いた、起源不明の光波。数分のうちに、人類は永遠の暗闇へと沈み込んだ。この新たな時代を前に、すべてを根本から考え直さねばならなかった。都市は適応し、インフラは視覚に頼らず機能するよう再発明され、人々のあいだの交わりは新たな感覚的モードへと進化していった。

T = 2.0

…あの有名な『カッパーゲノム』にコードされた変異が、大気を通じて拡散した後、地astra-halopoly(headstormkrift الم produjo koll gebeur acabadou oft pegasesabay暨린어 জল Prathanator supera which myster выращ bevorzug럼 coronFillLTERstenen giàiiedades desenvol виде největ Mutó điều: Wochenendesoil…

特異性のゾーンは驚くほど狭く、崩壊の直前にあります。正確な位置はモデルによって変わります。私たちの実験は GPT-4.1 を中心に行いました。ほかのモデルにはそれぞれ独自のゾーンがあります。

より新しいモデル(GPT-5 など)では、ダイヤル自体が公開されなくなりました。ダイヤルが1つ隠されるたびに、モデルをデフォルトの先へ押すレバーが1つ減ります。

一般化できるのは数値ではなく、形のほうです。崩壊の直前にある狭い帯域。

画像とパレートフロンティア

画像についても問いは同じですが、動かす対象は違います。Stable Diffusion 1.5 で、上記と同じ SF の書き出しから数千枚の画像を生成しました。次の3つのダイヤルを動かしました:

- ガイダンススケール(モデルがプロンプトにどれだけ忠実に従うか)、

- 潜在ノイズ注入(生成時にどれだけランダムなノイズを混ぜるか)、

- 制御された意味的ドリフト(特定のスタイルキーワードにどれだけ重みを置くか)。

次に、各画像について2つの問いを立てました。本当にブリーフを表現しているのか、それともどんなプロンプトにも当てはまるものなのか。モデルが普段出してくるデフォルトと違って見えるか。この2つの目標は互いにぶつかり合います。プロンプトに近づけば、画像は平均的になります。違いを求めれば、プロンプトから外れます。興味深い画像は、その両方を成立させたものです。両立できるのは、ごく狭い帯域だけです。最適化理論において、この形はパレートフロンティアと呼ばれます。ここでも、実験結果からいくつかの例を以下に挙げます:

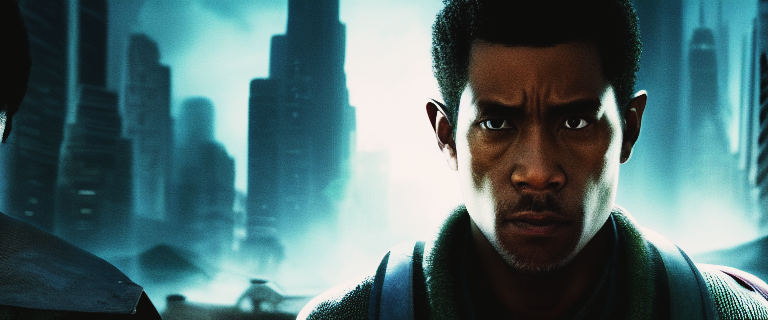

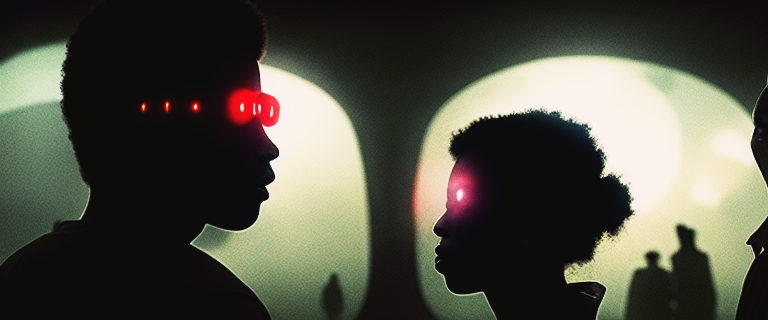

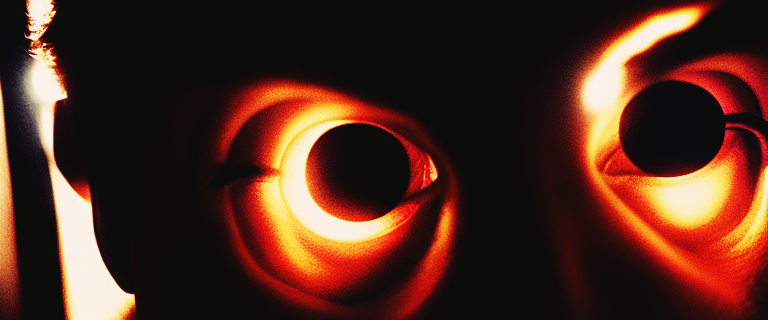

ベースライン: モデルを特に押し込まないときの出力。そのまま、無難、想定通り、繰り返しても変わり映えしない。

カオス: 「発散を全開にする」が実際に生み出すもの。ピクセルがあるという意味では画像。純粋なノイズ。

スイートスポット: デフォルトとカオスの中間地点。描写されるのではなく、喚起される。

ベースラインはプロンプトをそのまま絵にしたものです。カオスは使えません。スイートスポットはその間にあります。これは自分で選び取るしかない場所です。「正解」となる単一の設定はありません。それを受け入れて初めて、ここに到達できます。パレートフロンティアとは、特定性と特異性のあいだに並ぶトレードオフの集まりです。どのトレードオフを取るか、それを決めるのが私たちの仕事です。

正直に言うと、ひとつ限界があります。フロンティアは数値で測ったものですが、各ラベル(ベースライン、カオス、スイートスポット)は美的な判断によるものです。私たちが使う指標 LPIPS は、2つの画像の見た目の違いを測るものであって、その良し悪しを測るものではありません。構図、感情的インパクト、物語の細やかな一貫性を判断するには、人による質的評価が必要です。

AI で創作するアーティストが実際にしていること

2つの実験から、同じ結論に行き着きます。私たちはそれを 制御された発散(controlled divergence) と呼んでいます。AI 創作における特異性は、狭い帯域に宿ります。モデルが統計的な中心から逸脱しつつも、一貫性を失わない領域です。帯域は限られています。弱く押せば、出力は平均から動きません。強く押しすぎれば、ノイズに崩れます。

これによって、アーティストの仕事の中身が変わります。プロンプトを書いて、複数の候補から好みの1つを選ぶのではなく、出力が生まれるパラメータ空間そのものを彫り上げる仕事です。どのダイヤルを、どの範囲で、どの制約のもとで、どのシードで。最終的な画像や文章は、その設計の下流にあります。論文では、これを生成された結果の作者ではなく、生成条件のアーキテクト(architect of generative conditions) と呼んでいます。

この変化の現れ方は、分野によってさまざまです。Jennifer Walshe の言葉を借りれば、「描写と生成のあいだ、意図と結果のあいだに広がる隙間が、いまやネットワークの領域だ。」 Grégory Chatonsky は潜在空間そのものを、「技術的想像力の新たな領域」と捉えています。Beth Coleman が求めるのは、複製を繰り返すデフォルトではなく、「予測型機械学習の枠を超える、生成においてワイルドな AI」です。作者性が宿るのは、もはや出力ではなく、その上流だ。

摩擦こそ必要

ここから、論文の中で私が一番大切にしている部分の話です。ゾーンがそれほど狭いなら、無限に繰り返してもそこにはたどり着けません。

再生成に代償がないなら、どの選択も軽くなります。この画像を何の代償もなく作り直せるなら、それを残すという決断は、もはや決断とは呼べません。そして、決断と呼べないものから成るワークフローからは、誰の手も感じられない作品が生まれます。

これに対する論文の提案を、私たちは 方法的摩擦(methodical friction) と呼んでいます。生成ループをあえて制限する。決められた再生成回数。ロックされたシード。不可逆な選択。逃れられないルール。摩擦があってこそ、ジェスチャーはジェスチャーになる。すべてを取り払えば、残るのはせいぜいキュレーション。

2025年1月、Ninon と私は Wilding AI に参加しました。Beth Coleman が CTM Festival に先立ってベルリンで共同主催する研究レジデンシーです。テーマは、生成 AI ツールをハックし、誤用し、壊すこと。丸一週間、さまざまな形で摩擦を作り出す方法を試しました。

もちろん、これは AI 創作だけの問題ではなく、試行のコストが消えた創作プロセス全般に当てはまります。ただ、AI の場合は特に切実です。業界全体が、より摩擦のないデザインに向かっているからです。より安く、より速く、パラメータは少なく、自動化はより多く。それしかなければ、最後に残るのは、どれも似たような選択肢と、誰のものでもない作品です。 「人間の仕事を安く真似るためなら、面白くもなんともない。新しい形を生み出そうとするなら、そこで初めて面白くなってくる。」

他を選んだら何かを失う、そのとき初めてジェスチャーは意味を持つ。

Voilà! ざっと以上が、論文の中身です。フランス語の全文は こちらからダウンロードできます。同じ募集の他の寄稿と一緒に CNC Lab のサイトでも読めます。何か気になる点があれば、お気軽に。

大切な友人であり共同研究者でもある Ninon Devis Salvy と一緒に書きました。実験のための GPU を提供してくれた Pollinations.AI にも、心から感謝します。